La trampa de ChatGPT

Justo cuando nos íbamos recuperando de un gran malentendido, el terreno de juego cambia y caemos en un reto todavía más grande.

ChatGPT fue un éxito instantáneo. En pocas semanas ya lo usaban millones de personas.

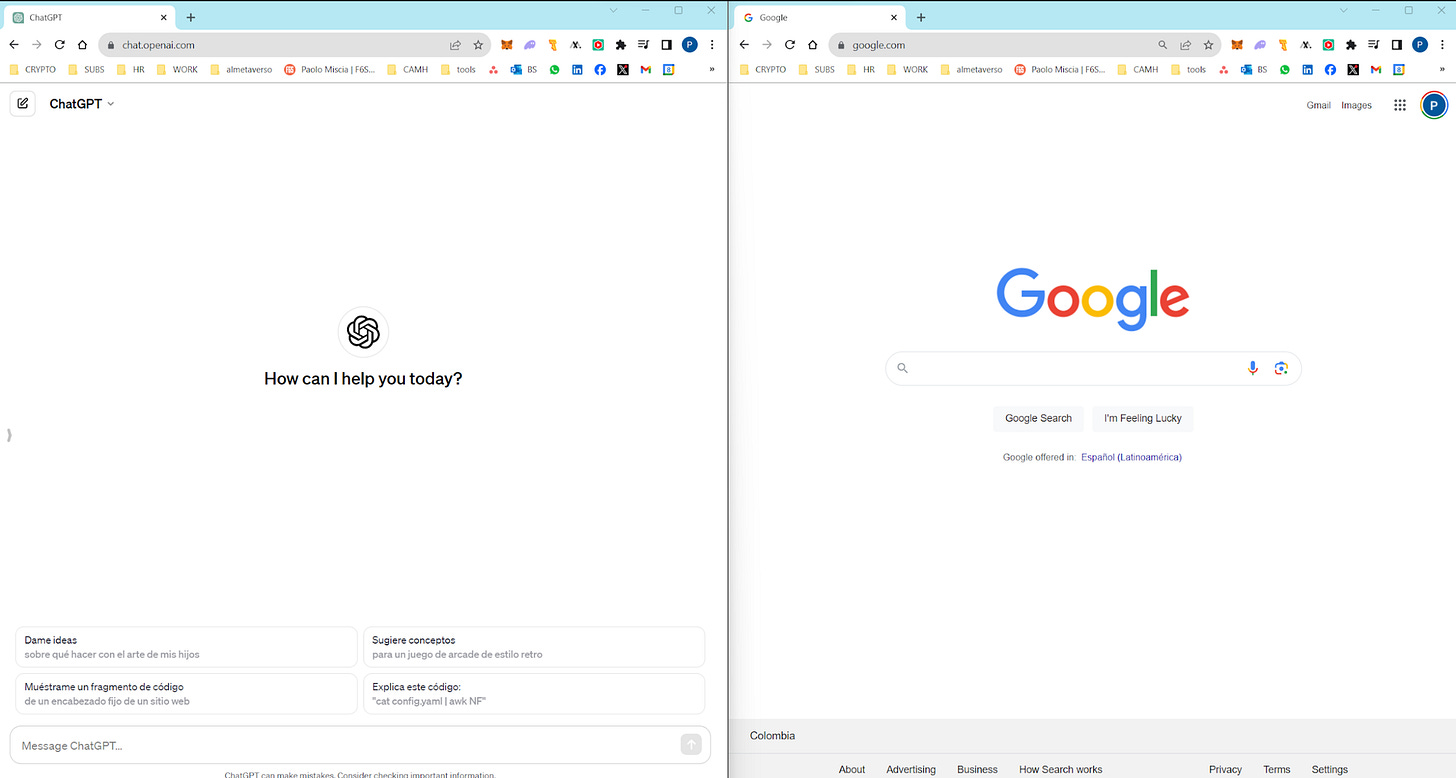

A este despegue tan rápido contribuyó sin duda su interfaz: fondo blanco, sencillez y un solo espacio central donde pedir los que quisieras. Algo parecida a la de Google, la página web más visitada en el mundo...

“¿Cómo te puedo ayudar?”, preguntaba. Ahí empezó el malentendido.

A esta invitación tan amplia respondimos de la manera que conocíamos y… empezamos a usarlo como un motor de búsqueda.

Abajo de la pantalla sí había una frase admonitoria -“ChatGPT can make mistakes. Consider checking important information”- pero le dedicamos la atención reservada a los términos y condiciones: cero.

Caímos entonces en la trampa: creímos que ChatGPT era la nueva “fuente de la verdad” - pero sin publicidad y más fácil de usar, ya que nos ahorraba el esfuerzo de hacer clic en los enlaces.

No creo que OpenAI lo haya hecho a propósito: al contrario. Ellos querían demostrar la potencia de sus GPTs y el enfoque conversacional era muy adecuado.

De ahí el nombre, perfectamente claro: es un GPT y puedes hablar con él.

El problema es que los únicos que entendieron el mensaje fueron pocos miles de científicos de datos, fascinados con el éxito de una nueva arquitectura (los Transformers) y admirados por los avances del scaling y las propiedades emergentes.

A los demás (centenares, luego miles, hoy 300 millones) nos pareció -más sencillamente- una milagrosa “máquina de respuestas”. Cómo Google, pero mejor.

No nos importó que el servicio no había sido expuesto a la información más reciente o que no tuviera conexión a internet.

Tampoco nos fijamos en las alucinaciones: estaban tan bien expresadas que las creímos todas.

Y menos nos preocupó la falta de fuentes: si lo dice “la máquina” debe ser cierto.

Poco a poco nos fuimos dando cuenta que los modelos grandes de lenguaje no son motores de búsqueda. Cada traspié, cada imprecisión nos hacía entender mejor la nueva herramienta.

Pero justo mientras estábamos volviendo a la sensatez empezó una evolución… “interesante”.

La cosa se pone complicada

Google seguro ya sabía que la Inteligencia Artificial generativa iba a amenazar su gran negocio de publicidad: conoce la tecnología mejor que nadie. Si se habían quedado quietos era solo para no auto-disrumpirse.

Quien primero se arrojó al agua fue su (distante) competidor de casa Microsoft, Bing. Fuerte de la alianza con OpenAI y con poco a perder lanzó sus AI generated answers en febrero del 2023.

A Google no le quedó sino responder con su versión: experimental, limitada, pasteurizada - pero al aire.

Gradualmente la Search Generative Experience evolucionó en los AI overviews, hoy el primer resultado de búsqueda que vemos quienes habilitamos la opción - una frase generada por Inteligencia Artificial suficiente para responder nuestra pregunta inicial.

Para complicar las cosas, al mismo tiempo iban surgiendo startups que atacaban el nuevo mercado de frente - Perplexity la más conocida- dedicadas exclusivamente a eso.

El mismo ChatGPT -y ya es historia reciente- se montó a la ola e introdujo su SearchGPT conectado en vivo y optimizado para la búsqueda (aunque sólo para suscriptores).

Hoy hay múltiples opciones para quien quiera usar un “answer engine”. Lo que era un comportamiento “equivocado” se transformó en una nueva manera de buscar.

Siendo esta “nueva manera” más práctica y menos demandante, es fácil prever que se irá expandiendo: más y más personas obtendrán una respuesta completa y bien articulada a sus preguntas y no un listado de enlaces.

Esta realidad nos hace entrever el reto que no esperábamos: un cambio en la manera como absorbimos conocimiento.

Vamos hacia el conocimiento “listo para comer”

El tránsito de “motor de búsqueda” a “motor de respuesta” tiene impacto sobre nuestro rol como seres humanos.

En el primero, una vez obtenida nuestra respuesta todavía nos queda trabajo por hacer: por lo menos hacer clic en un enlace y leer su contenido.

Es cierto que el 95% de las personas se quedan en los resultados de la primer página, pero la experiencia es equivalente a cocinar: Google nos devuelve los “ingredientes” (=enlaces), pero quien “cocina” (=extrae conocimiento) somos nosotros.

Con los nuevos “motores de respuesta” no hay que ensuciarse las manos (=activar el cerebro): la respuesta está allí, lista para comer.

La profundización va a seguir siendo posible - pero ya no va a ser necesaria. Muchos se saltarán ese paso, confiando en la respuesta “correcta”. Es la ley del mínimo esfuerzo.

¿Quién define cuál es esa respuesta correcta? Un algoritmo - tal cual lo hace hoy Google, para definir qué vemos y qué no vemos de internet.

El poder de este filtro lo conocen bien los medios de comunicación, condenados a bailar al son de esa fórmula mágica (y desconocida): si no apareces, no eres nadie.

En el mundo de los “answer engines” no habrá un listado de fuentes: sólo una respuesta ya empacada y lista para consumir. Los usaremos para que nos “revelen la verdad” - no buscando herramientas para construirla.

Este nuevo paradigma impactará cómo accedemos al conocimiento - y concentrará aún más el control sobre su distribución.